Tecnologia

‘Meu rosto, minhas regras’: por que cresce o apelo para banir tecnologias de reconhecimento facial?

A tecnologia de reconhecimento facial ganha espaço no Brasil e no mundo sob a justificativa da segurança. A ferramenta tem gerado protestos e debates sobre seu uso para o controle social. A Sputnik Brasil ouviu especialistas que discutem problemas como soberania de dados, as implicações no racismo e os limites legais envolvidos no tema.

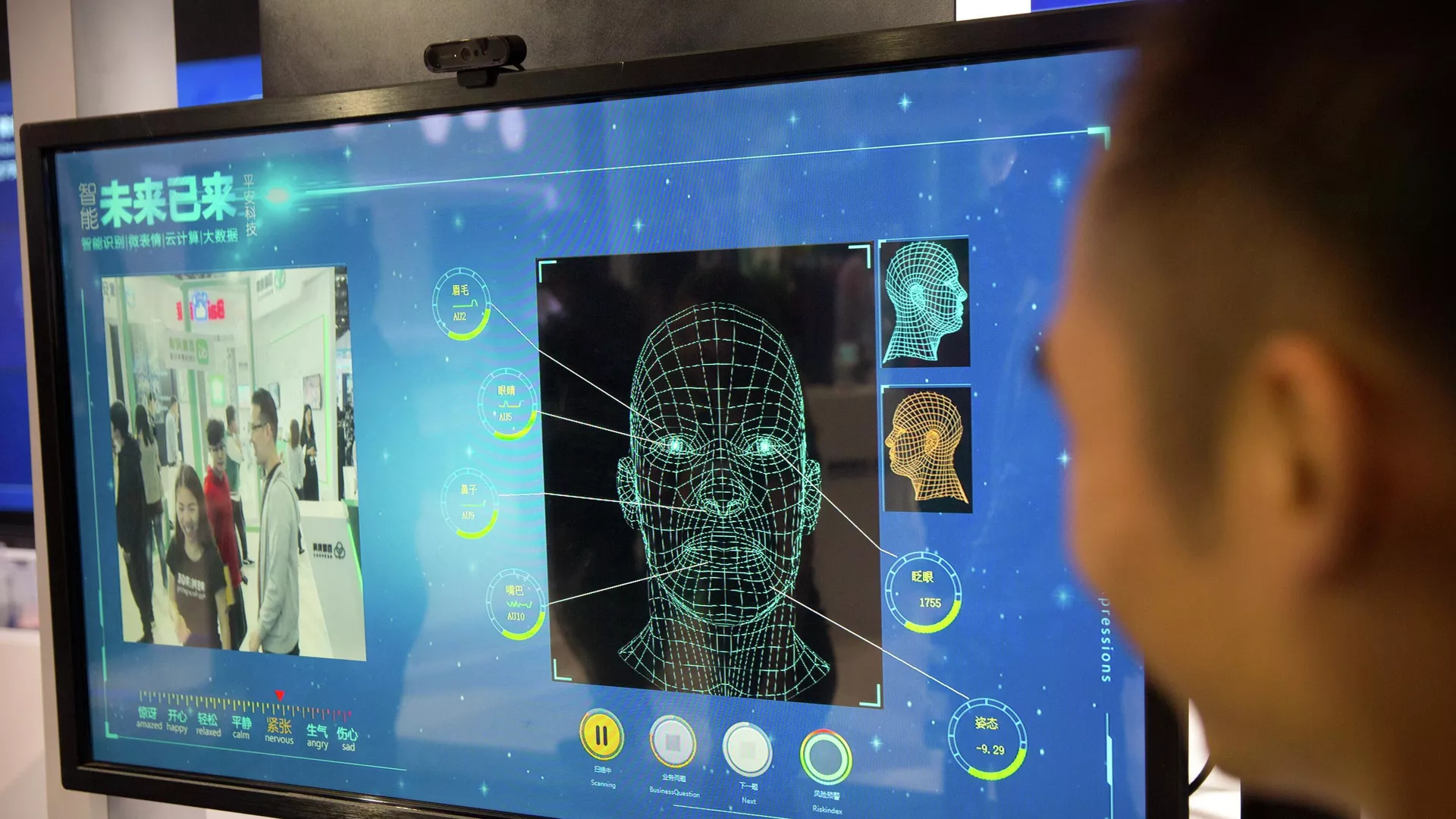

© AP Photo / Mark Schiefelbein

“Não houve qualquer justificativa, por parte do Metrô de São Paulo, para fundamentar o uso massivo de reconhecimento facial em suas estações. Tampouco houve uma informação clara sobre a finalidade específica do tratamento de dados pessoais biométricos de todos os usuários do metrô, sua destinação, compartilhamento ou armazenamento em banco de dados”, recorda Machado, citando a Lei Geral de Proteção de Dados (LGPD).

“As violações vão desde o direito à privacidade e à proteção de dados até o direito à igualdade e à não discriminação”, afirma Alcântara à Sputnik Brasil, acrescentando que uma indenização de quase R$ 43 milhões foi solicitada na ação devido às violações de direitos dos usuários do metrô.

“Os dados são ativos econômicos valiosos na atualidade. Eles são o principal insumo de plataformas trilionárias como Google, Facebook, Amazon, entre outras”, afirma à Sputnik Brasil Sergio Amadeu, pesquisador da área de tecnologia e dados e professor da Universidade Federal do ABC (UFABC), acrescentando que, após análise e tratamento, as informações extraídas podem ser usadas para o desenvolvimento de produtos e serviços.

Tecnologia tem problemas, mas avança no país

Reconhecimento facial pode agravar racismo no Brasil

“Apesar da ampla adoção, das biometrias dominantes em uso — impressão digital, íris, palma da mão, voz e rosto —, o reconhecimento facial é o menos preciso, mais racista e o mais problemático em relação à privacidade de dados”, avalia a cientista da computação Nina da Hora em entrevista à Sputnik Brasil.

“É preciso entender a preocupação que, a partir do uso e comparação de fotos, há por trás uma visão eugenista — de usar fenótipo para tomar decisões. No Brasil essa percepção já está muito enraizada na sociedade”, aponta a cientista da computação.

“Sistemas algorítmicos e tecnologias com qualquer tipo de automatização de processos são muito imprecisas, mas são implementadas a toque de caixa e aceitas socialmente pois as vítimas da violência estatal são sobretudo pessoas negras”, afirma Silva à Sputnik Brasil.

“É essencial entender muito além de minúcias de linhas de programação, mas como a promoção acrítica de implementação de tecnologias digitais para ordenação do mundo favorece a reprodução dos desenhos de poder e opressão que já estão em vigor”, diz Tarcízio Silva ao explicar o conceito cunhado pelo autor Anupam Chander, da Universidade de Georgetown, nos EUA.

Banimento do reconhecimento facial

“Acreditamos que a moratória, por ora, e, depois, o consequente banimento são as medidas mais adequadas diante de sistemas massivos de reconhecimento facial ou de outros dados biométricos. O vigilantismo promovido por essas tecnologias, quando usadas indiscriminadamente, é um inimigo de uma sociedade civil livre, criativa e pujante”, aponta a advogada Eloísa Machado, professora da FGV.

“Tal posicionamento vem da análise de que esse uso já se mostra, por princípio, incompatível com a proteção dos direitos humanos. De diversas maneiras a vigilância biométrica em massa afeta os direitos humanos”, diz Alcântara.

“No momento, o reconhecimento facial tem servido à discriminação dos segmentos mais fragilizados da população, como os jovens negros da periferia. Acredito que precisamos de uma moratória do uso das tecnologias de reconhecimento facial. Precisamos discutir sua real aplicação, seus vieses, seus reveses e como mantê-las sob o controle democrático da sociedade”, defende Amadeu.

“Não se trata apenas de como a tecnologia erra com mais frequência com grupos minorizados, mas das próprias concepções de segurança pública envolvidas. Hipervigilância não só não diminui o crime, como promove a violência estatal e restringe a liberdade de todos e quaisquer cidadãos através de um clima de suspeição generalizada”, afirma.

“É a gente olhar para os problemas sociais e estruturais e achar que todos eles serão resolvidos com tecnologia. É como se estivéssemos negligenciando a nossa capacidade como seres humanos, seres pensantes que conseguem promover uma solução. É como se estivéssemos substituindo toda essa percepção humana por máquinas”, conclui.

Até o fechamento desta reportagem, o Metrô de São Paulo não respondeu as perguntas enviadas.

Tecnologia

“Brainrot”, você tem isso? Conheça esse efeito colateral da vida digital

Termo descreve a “deterioração mental” causada por consumir grandes quantidades de conteúdo de baixo valor, como memes e vídeos sem sentido

“Brainrot” pode afetar negativamente as habilidades cognitivas das pessoas

Unsplash/Taylor Deas-Melesh

Se você leu meu texto sobre a slopficação da internet, talvez agora você fique um pouco mais assustado. Senta que lá vem a história…

Se você é millennial, como eu, e tinha uma certa esperança que a próxima geração seria melhor e daria conta de um monte de coisas que não conseguimos, bem… nascer e crescer imerso em redes sociais parece que não está fazendo muito bem, pelo menos na construção de gosto e o que se escolhe consumir online.

Entender minimamente a GenZ (Geração Z) e a Geração Alpha tem consumido boa parte do tempo das minhas pesquisas online. Sacar os movimentos e tentar entrar na cabeça dos jovens é interessante e surpreendente, já que os valores e gostos são completamente diferentes. E olha que pra muita coisa eu sou mais Z que Y.

Mas vamos para o que interessa. Você já ouviu ou viu, em algum lugar, termos como:

- Skibidi Toilet

- Level Five Gyat

- Rizz

- Fanum Tax

- Only in Ohio

- Sigma Looksmaxxing

- Grimace Shake

Parece erro, palavras sem sentido, mas eles têm aparecido com frequência em uma série de conteúdos virais, mais especificamente memes, e que têm sido atribuídos ao tal do “brainrot”. Se você perguntar para o Google Tradutor, não vai conseguir nada. Já para o ChatGPT, ele traz uma luz. Olha só:

ChatGPT oferece definição de termos que têm sido atribuídos ao “brainrot” / Reprodução/ChatGPT

Acho que, com isso, você já consegue ir sacando o que é “brainrot”. Apesar desse termo ser antigo (usado desde 2004), é agora que ele está bombando em redes sociais muito usadas por jovens da GenZ, como o TikTok.

E não é pouco dizer que esses jovens internautas estão obcecados com a tal “brain rot” ou “brainrot”. Tanto que a própria viralização do termo explica muito o que estamos vivendo nos tempos atuais: “doomscrolling“, essa rolagem infinita nos nossos feeds, e também nosso estado online crônico.

Traduzido por “podridão cerebral”, “apodrecimento do cérebro” ou até “cérebro apodrecido”, o termo, ou condição, descreve a “deterioração mental” causada por consumir grandes quantidades de conteúdo de baixo valor, como memes e vídeos sem sentido, que podem afetar negativamente as habilidades cognitivas e a capacidade de pensar criticamente.

Longe de ser um termo médico ou científico, é simplesmente um efeito colateral do nosso comportamento online, principalmente em redes sociais, frequentemente motivado por um desejo compulsivo de se manter atualizado, principalmente com eventos negativos, mesmo quando isso pode ser emocionalmente desgastante ou prejudicial para a saúde mental.

Basicamente, estamos gastando mais tempo e literalmente nos entregando e absorvendo grandes quantidades de informações irrelevantes e de baixa qualidade.

Sem entrar nas questões neurodegenerativas, não precisamos de muito para entendermos que, ao consumirmos conteúdos piores, ficaremos piores. Ou seja, nossos cérebros vão trabalhar com o que recebem. Se consumimos porcarias, vamos pensar em porcarias. Simples assim.

E tem muita gente online falando que já está com “brainrot” só de ter recebido ou passado por certos conteúdos, justamente porque estão muitos expostos a eles. E assim como os “slops” causam uma certa confusão mental, os conteúdos associados ao brainrot também, desassociando imagens ou conceitos de seus contextos reais.

Um exemplo é a imagem de um soldado da Segunda Guerra Mundial com um olhar atordoado, que faz parte da pintura de Tom Lea “That 2,000 Yard Stare“, que é usado em muitos conteúdos meméticos, e que TikTokers dizem ser brainrot.

Popularização e perigos

Fazendo uma pesquisa rápida no Google Trends, percebemos que tivemos uma procura maior do termo em 2005 e 2010, mas, a partir da segunda metade de 2023 até agora, o termo explodiu. E é interessante notar que esses picos estão muito associados à cultura gamer e a jogos que contribuíram com seu uso ao longo da década de 2010.

Inclusive, “brainrot” é uma doença que os jogadores podem contrair no jogo de “2011 The Elder Scrolls V: Skyrim“. Em 2007, ano que muita gente considera o surgimento do termo, ele aparece em posts no X, nos quais os usuários descreviam reality shows de namoro, videogames e certos comportamentos, como brainrot.

Um artigo recente do NYT, Jessica Roy relata como alguns usuários do TikTok até começaram a criar paródias de pessoas que parecem “ter” essa condição, ajudando, assim, na popularização, ridicularização e adoção do termo. E, apesar de não ser um elogio falar que alguém tem brainrot, algumas pessoas demonstram um leve orgulho ao admitir a condição.

Em um quiz recente do BuzzFeed, dava até pra saber se “o seu cérebro está 1000% cozido”. Outra leva de vídeos fala que quanto mais gírias da internet uma pessoa usa, mais brainrot ela tem.

E apesar do humor que tudo isso traz, existe um lado bem ruim. Sabe quando a gente fica obcecado por algo e vê aquilo em todo lugar, ou quando gostamos tanto de um personagem ou uma celebridade e começamos a ficar parecidos com elas? Bem, consumir conteúdos de baixa qualidade pode nos deixar menos preparados a certaz situações e “menos inteligentes”, como colocam os jovens com brainrot. Muitos compartilham nas redes seu medo de ficaram “burros”.

Há muitos pesquisadores que estão se debruçando nesse tema, como o neurocientista Michel Desmurget, que tem um livro bastante controverso, assim como outros que se adentram nesse tema, “A fábrica de cretinos digitais: Os perigos das telas para nossas crianças”.

Esse medo de ficarmos piores cognitivamente é real, porque somos o que comemos e consumimos. A “Geração Touch” e as “crianças de iPad” certamente carregam consequências disso, tanto pela tela e o aumento de miopia, muita quantidade de luz azul, que traz alterações no sono, e por aí vai, até o que é visto, assistido e lido.

Em toda a história da humanidade, acompanhamos as consequências boas e ruins das mais diversas tecnologias que foram sendo introduzidas nas nossas vidas, e se tratando de internet, hoje e sempre, independente da tecnologia em si, sabemos que “gostamos” de certos conteúdos justamente pelo modo como nosso próprio cérebro funciona.

Nem vou entrar nessa discussão, porque isso daria um outro texto, mas, no caso dos memes, eles são divertidos, rola uma conexão emocional positiva com eles, e isso dá uma ajudinha na disponibilidade de dopamina no nosso cérebro. É entretenimento puro e viciante.

Por isso mesmo, existem muitos pesquisadores interessados no assunto, tanto que, nos Estados Unidos, diversas instituições de saúde já estão estudando isso como um distúrbio. No artigo no NYT, é citada a pesquisa do Hospital Infantil de Boston, que chama essa condição de “Uso Problemático de Mídia Interativa”. E ela mostra que, conforme passamos muito tempo online, mudamos nossa percepção do espaço físico para o online, e isso tem consequências.

E a GenAI nessa história?

Brainrot está na moda hoje em dia, assim como a GenAI (inteligência artificial generativa). Mas será que a IA está ajudando a nos levar a um estado de brainrot generalizado?

Se o uso preguiçoso da GenAI pode nos fazer desenvolver menos algumas habilidades ao longo do tempo, não há dúvida. É como foi com a nossa memória, tanto que hoje não guardamos o número do celular de quase ninguém. Claro que nesse cas,o é reversível, podemos treinar e melhorar, graças a neuroplasticidade cerebral.

Mas, assim como a internet está se “slopificando”, ou seja, sendo tomada por conteúdos sem valor sendo gerados sinteticamente, nós também poderemos acabar nos deparando cada vez mais com esse conteúdo, e (por que não?) aumentando o brainrot, assim como nos enganando cada vez mais por conteúdos falsos. As consequências de longo prazo não sabemos, e muito estudo ainda será feito, mas, com certeza, uma coisa pode alimentar a outra.

Deveríamos nos preocupar com o “brainrot”?

Em certo sentido, sim, embora devamos ser cautelosos ao soar o alarme sobre o que impulsiona ou leva ao “brainrot”. É muito fácil referir-se a praticamente qualquer coisa como causadora de “brainrot”, se formos pensar.

A cultura da internet sempre traz questões e termos interessantíssimos que podem nos fazer pensar e desenvolver muitas teorias e conceitos. Brainrot ainda é uma expressão que carece de rigor científico, principalmente para descrever ou quantificar a saúde mental real. Mesmo assim, não significa que devemos ignorar ou minimizar as preocupações que estão no cerne desse termo.

Tecnologia

Tik Tok planeja lançar o Whee, plataforma de fotos ‘cópia’ do Instagram

Na plataforma, será possível manter um feed de imagens, utilizar filtros nas fotos tiradas pelo próprio aplicativo, além de manter um fluxo de conexão de amigos

UE abre investigação contra TikTok por possível violação das normas – (crédito: Reprodução/Freepik)

O TikTok está trabalhando em seu próprio Instagram, afirmou o site Android Police na terça-feira, 18. O aplicativo, chamado Whee, tem como objetivo o compartilhamento de fotos com melhores amigos – uma mistura da rede de Mark Zuckerberg com o BeReal, de fotos instantâneas e não editadas. O app, que já pode ser utilizado em alguns países, ainda não chegou ao Brasil.

De acordo com as imagens vistas pelo Android Police, o Whee é um app separado do TikTok, mas também mantido pela ByteDance. Na plataforma, é possível manter um feed de imagens, utilizar filtros nas fotos tiradas pelo próprio aplicativo, além de manter um fluxo de conexão de amigos.

Configurações básicas como curtidas e comentários também estão presentes, em um layout bastante parecido com o do Instagram.

“Capture e compartilhe fotos da vida real que somente seus amigos podem ver, permitindo que você seja mais autêntico”, afirma a descrição do Whee no Google Play, loja de apps do Android. “Whee é o melhor lugar para amigos próximos compartilharem momentos da vida”, completam.

O TikTok e a ByteDance ainda não se pronunciaram oficialmente sobre o aplicativo, mas já é possível encontrar a nova rede social em alguns países em celulares com sistema operacional Android.

Tecnologia

YouTube testa recurso que introduz “notas” de contexto em vídeos

Testes começarão nos Estados Unidos e serão feitos, inicialmente, com usuários e criadores selecionados

O YouTube anunciou, nesta segunda-feira (17), que permitirá em breve que os usuários adicionem “notas” que fornecerão contexto sobre alguns de seus vídeos. Os testes fazem parte de um novo recurso que inicialmente será lançado nos Estados Unidos.

A plataforma convidará alguns usuários e criadores de conteúdo, como parte da fase inicial de teste, para escrever notas destinadas a fornecer “contexto relevante, oportuno e fácil de entender” sobre os vídeos.

As notas, por exemplo, poderão esclarecer quando uma música é uma paródia, apontar quando uma nova versão de um produto que está sendo analisado estiver disponível ou informar aos espectadores quando imagens antigas são erroneamente apresentadas como eventos atuais.

A rede social X, antigo Twitter, possui um recurso semelhante chamado Notas da Comunidade, que permite que colaboradores selecionados adicionem contexto às publicações, incluindo tags como “enganoso” e “fora de contexto”.

O recurso de notas no YouTube será, inicialmente, disponibilizado em dispositivos móveis para usuários nos Estados Unidos e em inglês. Nessa fase, avaliadores externos classificarão a utilidade das notas, o que ajudará a treinar os sistemas, antes de um possível lançamento mais amplo, disse o YouTube.

*Com reportagem de Yuvraj Malik, em Bengaluru

CNN Brasil

-

Mundo8 meses atrás

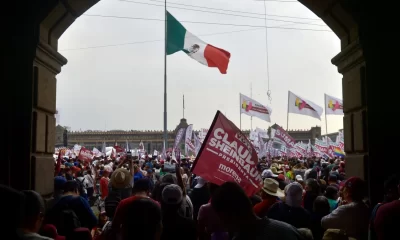

Mundo8 meses atrásMéxico vai às urnas em eleição histórica e pode eleger 1ª presidente mulher

-

Geral8 meses atrás

Geral8 meses atrásSaiba como fica a composição do TSE com a saída de Moraes e a chegada de André Mendonça

-

Geral8 meses atrás

Geral8 meses atrásApós derrotas no Congresso, Lula faz reunião com líderes do governo nesta segunda (3)

-

Política8 meses atrás

Política8 meses atrásApoio de Bolsonaro e estrutura do PL podem levar Fernando Rodolfo ao segundo turno em Caruaru, mostra pesquisa

-

Saúde7 meses atrás

Saúde7 meses atrásCientistas descobrem gene que pode estar associado à longevidade

-

Polícia8 meses atrás

Polícia8 meses atrásHomem é executado em plena luz do dia em Bom Conselho

-

Comunidade8 meses atrás

Comunidade8 meses atrásMoradores do São João da Escócia cobram calçamento de rua há mais de 20 anos

-

Comunidade8 meses atrás

Comunidade8 meses atrásEsgoto estourado prejudica feirantes e moradores no São João da Escócia